필립스, 심장 판막 수리를 안내하는 AI 도구 출시

페이지 정보

본문

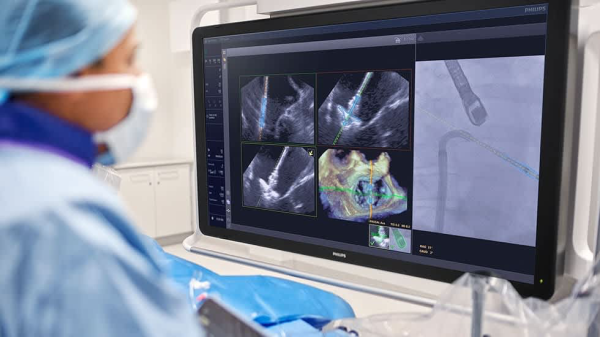

Philips는 일요일 최소 침습 심장 판막 수리를 수행하는 의사들을 실시간으로 지원하도록 설계된 인공지능 솔루션인 DeviceGuide를 소개했습니다. London Valves 2025에서 공개된 이 기술은 시술이 진행되는 동안 적극적으로 중재 시술을 안내하는 회사의 첫 번째 AI 기반 도구입니다.

DeviceGuide는 AI 알고리즘을 사용하여 승모판 경카테터 엣지-투-엣지 수리 시술 중 박동하는 심장을 통과하는 수리 기기를 자동으로 추적하며, 실시간 심초음파 및 X-ray 영상을 지능적으로 융합합니다. 이 소프트웨어는 실시간 심장 영상에 중첩된 치료 기기의 가상 3D 모델을 생성하여 시술 중 임상의에게 정확한 기기 위치와 방향을 보여줍니다.

기술적 과제 해결

이 솔루션은 중재 심장학에서 가장 까다로운 시술 중 하나인 승모판 역류 복구를 다룹니다. 이는 전 세계적으로 3,500만 명 이상의 성인에게 영향을 미치는 질환입니다. 이 질환을 가진 환자들은 심장의 승모판을 통해 혈액이 역류하는 현상을 경험하며, 이는 종종 호흡 곤란과 피로를 유발합니다.

M-TEER 시술 중, 의사들은 전통적으로 작은 절개를 통해 복구 장치를 조작하면서 별도의 X-레이와 초음파 화면을 보며, 심장의 해부학적 구조를 머릿속으로 재구성해야 합니다. 필립스의 진단 및 치료 부문 최고 의료 책임자인 Atul Gupta 박사는 시술의 복잡성을 설명하며 “회전하고 있고 벽이 투명한 움직이는 테니스 공 안의 목표물을 맞추려고 하는 것을 상상해 보십시오”라고 말했습니다.

필립스의 EchoNavigator 플랫폼을 기반으로 구축된 DeviceGuide는 회사의 Azurion 이미지 유도 치료 시스템에서 실행됩니다. 이 기술은 임플란트가 움직일 때 자동으로 그 윤곽을 인식하고 강조하며, 모든 작은 움직임을 실시간으로 분석합니다.

산업 협력

Philips는 PASCAL Ace 수리 장치 제조업체인 Edwards Lifesciences와 협력하여 DeviceGuide를 개발했습니다. 이 솔루션은 현재 승모판 수리를 위한 Edwards의 PASCAL Ace 임플란트와 독점적으로 작동합니다.

Philips의 Image Guided Therapy Systems 사업 책임자인 Mark Stoffels는 “DeviceGuide는 선도적인 이미징 및 치료 전문 기술을 결합하여 시술 워크플로우를 중심으로 설계된 솔루션을 개발하는 것의 영향력을 보여줍니다”라고 말했습니다.

이 기술의 이용 가능 여부는 현지 규제 승인에 따라 달라지며, 아직 모든 국가에서 판매 승인을 받지 못했습니다. 이 시스템은 Philips가 심장을 위한 GPS와 유사한 내비게이션이라고 설명하는 기능을 제공하며, 시술 중 수동 조정을 잠재적으로 줄일 수 있습니다.

11월 16-18일에 개최된 London Valves 2025는 판막 심장 질환에 대한 경카테터 치료에 초점을 맞춘 주요 연례 회의입니다.