엔비디아, 사기 주장 속에서 회계 관행 옹호

페이지 정보

본문

Nvidia는 회계 사기 혐의를 명시적으로 부인하고 인공지능 투자가 버블이라는 주장에 반박하기 위해 월스트리트 애널리스트들에게 7페이지 분량의 메모를 배포하는 이례적인 조치를 취했다고 여러 보도에 따르면 밝혀졌다.

이 칩 제조업체의 투자자 관계팀은 2025년 11월 23-24일 주말에 메모를 발송했으며, 2008년 주택 위기를 정확히 예측했던 투자자 마이클 버리(Michael Burry)의 최근 비판과 "기술 역사상 최대 규모의 회계 사기"가 될 수 있다고 주장하는 바이럴 Substack 게시물을 다루었다. Barron's가 입수한 이 메모는 회사의 시그니처 녹색 폰트로 작성되었으며, AI 가치평가가 점점 더 많은 조사를 받고 있는 시점에 Nvidia의 비즈니스 관행에 대한 직접적이고 날카로운 방어를 나타낸다.

버리의 주장과 엔비디아의 대응

메모는 엔비디아의 주식 기반 보상이 "오너의 수익을 50% 감소시키며" 주주 가치를 훼손했다는 버리의 주장에 대해 구체적으로 반박했다. 엔비디아는 "2018년 이후 910억 달러의 주식을 환매했으며, 1,125억 달러는 아니다"라고 명확히 밝혔고, "버리 씨가 계산에 RSU[제한조건부주식] 세금을 잘못 포함한 것으로 보인다"고 밝혔다. 회사는 직원 지분 지급과 주식 환매 실적을 혼동해서는 안 된다고 강조했다.

광범위한 회계 사기 의혹과 관련하여 엔비디아는 자신과 과거의 기업 스캔들 사이에 뚜렷한 경계를 그었다. 메모는 "엔비디아는 역사적인 회계 사기와는 닮지 않았습니다. 엔비디아의 근본적인 사업은 경제적으로 건전하고, 보고는 완전하고 투명하며, 우리는 우리의 진실성에 대한 평판을 중요하게 생각합니다"라고 밝혔다. 회사는 엔론과 달리 부채를 숨기거나 매출을 부풀리기 위해 특수목적법인을 사용하지 않는다고 구체적으로 언급했다.

버리는 X에 게시물을 올려 엔비디아의 반박을 인정하며 "나는 내 분석을 지지한다"고 썼다. 하지만 자신의 입장도 명확히 했다: "나는 엔비디아가 엔론이라고 주장하는 것이 아닙니다. 분명히 시스코입니다"—2000년 이후 80% 이상 폭락하기 전 닷컴 붐 당시 주가가 3,800% 급등했던 네트워크 대기업 시스코를 언급한 것이다.

순환 금융 우려

이 메모는 또한 엔비디아가 투자한 AI 기업들이 엔비디아의 칩을 구매하는 이른바 순환 자금 조달(circular financing)에 대한 우려를 다뤘다. 비평가들은 엔비디아가 9월에 발표한 오픈AI에 대한 1,000억 달러 약속과 최근 Anthropic에 대한 100억 달러 투자를 회사가 본질적으로 자신의 매출을 스스로 자금 지원하는 사례로 지적했다.

엔비디아는 자사의 전략적 투자가 "엔비디아의 수익에서 작은 비중만을 차지하며, 글로벌 사모 시장에서 매년 약 1조 달러가 조달되는 것에 비하면 더욱 작은 비중이다"라고 반박했다. 회사는 포트폴리오 기업들이 "대부분 타사 고객으로부터 수익을 창출하며, 엔비디아로부터 나오는 것이 아니다"고 덧붙였다.

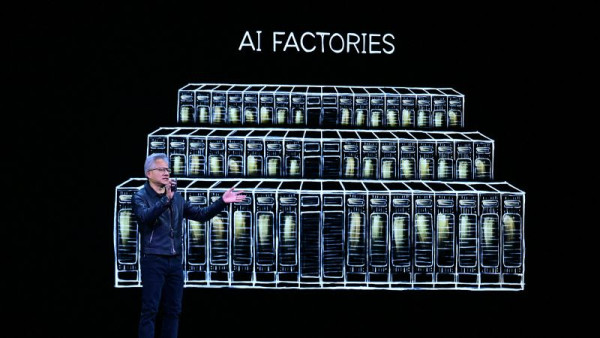

엔비디아는 최근 분기 실적에서 전 분기 대비 62% 증가한 570억 달러의 사상 최대 분기 매출을 기록했음에도 불구하고, 주식은 여전히 변동성을 보이고 있다. 2025년 11월 25일 주가는 182.55달러 근처에서 거래되었으며, 실적 발표 이후 큰 변동을 겪었다. CEO 젠슨 황은 내부 회의에서 직원들에게 회사가 "승자가 될 수 없는 상황(no-win situation)"에 처했다고 말하며, "실적이 나쁘면 AI 버블이 있다는 증거가 되고, 실적이 좋으면 우리가 AI 버블을 부추긴다는 말이 나온다"고 말했다.

버리의 헷지펀드인 스씨온 에셋 매니지먼트는 11월 초 기준으로 엔비디아와 팔란티어에 대한 풋옵션을 10억 달러 이상 보유하고 있었으며, 이후 몇 주 뒤 펀드의 등록을 취소했다. 레이몬드 제임스 분석가인 사이먼 레오폴드는 메모 이후 엔비디아를 옹호하며 "체계적 사기라는 논리는 엔비디아의 펀더멘털과 일치하지 않는다"고 썼다.