마이크로소프트, 파일 접근 기능을 갖춘 AI 에이전트를 Windows 11에서 테스트

페이지 정보

본문

(퍼플렉시티가 정리한 기사)

Microsoft는 Windows 11 테스터들에게 실험적인 AI 에이전트 기능을 배포하기 시작했으며, 이는 인공지능 비서가 사용자 파일에 접근할 수 있는 격리된 작업 공간에서 독립적으로 작동할 수 있도록 허용합니다. 이러한 움직임은 사용자들 사이에서 기술적 관심과 개인정보 보호 우려를 동시에 불러일으켰습니다.

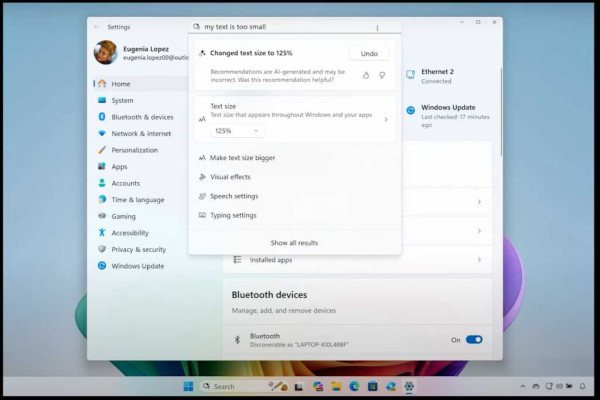

Microsoft는 11월 16일 Dev 및 Beta 채널에 Windows 11 Insider Preview Build 26220.7262를 출시하며, 설정 앱의 시스템 및 AI 구성 요소 하위 메뉴에 새로운 "실험적 에이전트 기능" 토글을 도입했습니다. 이 기능은 기본적으로 비활성화되어 있으며 활성화하려면 관리자 권한이 필요하며, Microsoft가 "에이전트 작업 공간"이라고 부르는 것을 가능하게 합니다. 이는 사용자가 계속 작업하는 동안 AI 에이전트가 백그라운드에서 작업을 완료할 수 있는 별도의 격리된 Windows 환경입니다.

에이전트 워크스페이스 작동 방식

Microsoft의 공식 문서에 따르면, Agent Workspace는 단일 PC에서 여러 사용자 계정을 사용하는 것과 유사하게 AI 에이전트를 위한 별도의 Windows 세션을 생성합니다. 각 에이전트는 개인 사용자 계정과 분리된 자체 계정으로 작동하며, 범위가 지정된 권한 부여와 런타임 격리를 통해 에이전트 활동과 사람 사용자 간의 경계를 설정합니다.

활성화되면 에이전트 애플리케이션은 문서, 다운로드, 바탕 화면, 음악, 사진, 동영상 등 6개의 특정 폴더에 대한 액세스를 요청할 수 있습니다. Microsoft는 이 시스템을 "Windows Sandbox와 같은 완전한 가상 머신보다 효율적이면서도 보안 격리, 병렬 실행 지원을 제공하고 사용자가 제어권을 유지할 수 있도록 합니다"라고 설명합니다.

Copilot Actions는 이 작업 공간을 활용하는 첫 번째 애플리케이션으로, 사용자가 AI에게 다운로드 정리, 사진 분류, 파일 변환 또는 PDF에서 정보 추출을 요청할 수 있습니다. 이 기능은 Microsoft Store 업데이트를 통해 전 세계 Windows Insider에게 점진적으로 출시되고 있습니다.

반발과 보안 우려

이번 발표는 11월 10일 마이크로소프트의 Windows 및 Devices 사장인 Pavan Davuluri가 "Windows가 에이전트 기반 OS로 진화하고 있다"고 밝힌 게시물 이후 상당한 사용자 반발이 일어나는 가운데 나왔다. 해당 게시물은 개발자와 사용자들로부터 심한 비판을 받았고, Davuluri는 댓글을 비활성화한 뒤 11월 14일 팀이 "경험 개선을 위해 해야 할 일이 있다"고 인정했다.

마이크로소프트는 실험적인 에이전트 기능이 성능에 영향을 미칠 수 있으며 AI 환각 및 교차 프롬프트 주입 취약점을 포함한 보안 위험을 초래할 수 있다고 경고한다. 회사는 에이전트 활동을 추적하기 위한 변조 방지 감사 로그와 함께 부인 방지, 기밀성 및 사용자 권한 부여를 포함한 보안 원칙을 강조한다. 사용자는 언제든지 접근 권한을 취소하고 에이전트 작업 공간을 종료할 수 있지만, 마이크로소프트는 이 기능을 끄면 에이전트가 프로필 폴더에 접근할 수 없게 된다고 경고한다.