AI 현미경이 2D 물질 분석에서 인간 전문가와 대등한 수준 달성

페이지 정보

본문

(퍼플렉시티가 정리한 기사)

듀크 대학교의 연구원들은 훈련된 인간 전문가와 동일한 정밀도로 2차원 재료를 분석할 수 있는 인공지능 현미경 시스템을 개발했으며, 이는 자율 과학 연구에서 중요한 돌파구를 의미합니다. ATOMIC(Autonomous Technology for Optical Microscopy & Intelligent Characterization)이라고 불리는 이 시스템은 재료 결함 및 층 구조를 식별하는 데 최대 99.4%의 정확도를 달성했습니다.

기초 모델의 혁신적 통합

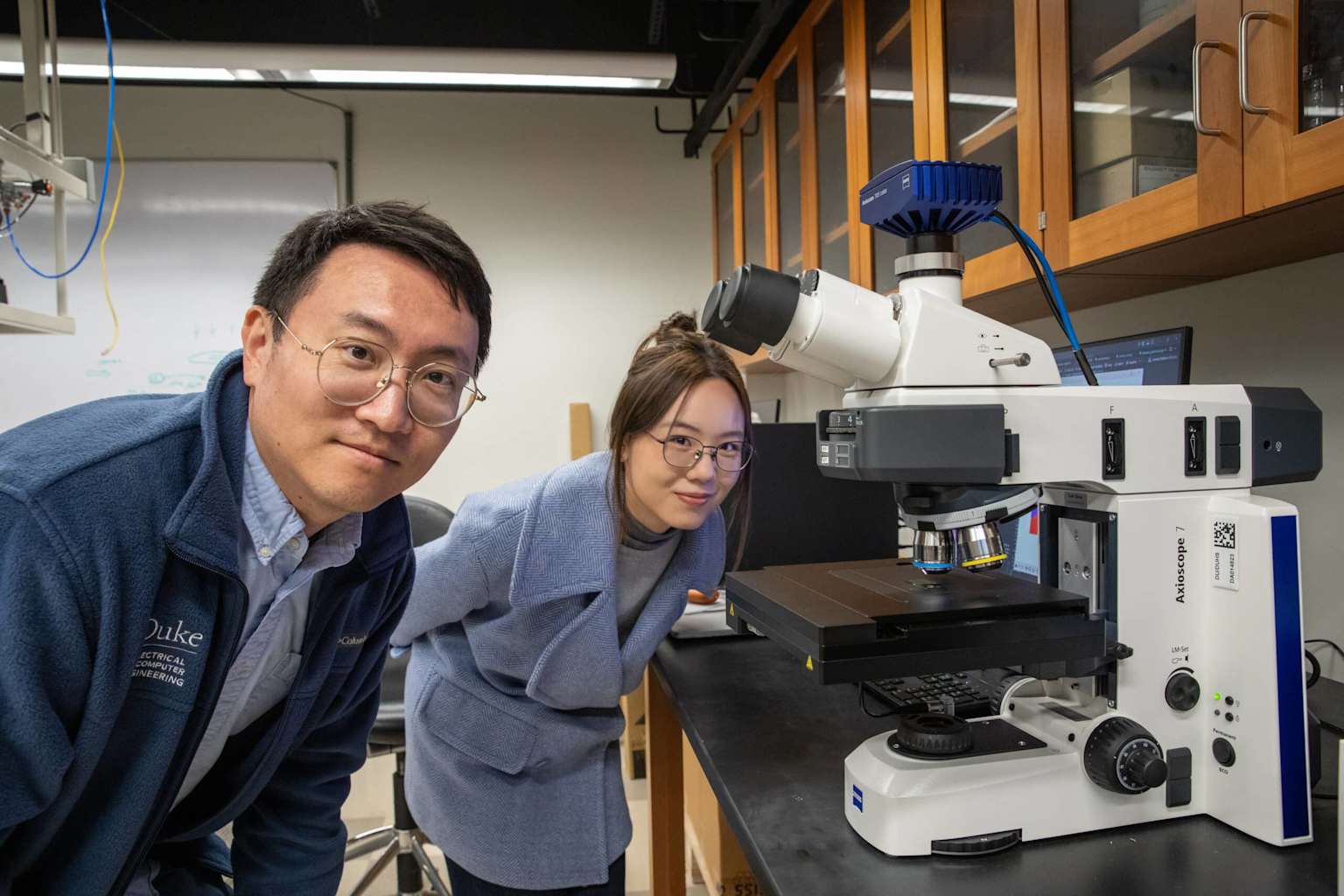

10월 2일 ACS Nano에 발표된 이 획기적인 연구는 공개적으로 이용 가능한 AI 기반 모델들—특히 OpenAI의 ChatGPT와 Meta의 Segment Anything Model (SAM)—을 자율 실험실 장비에 성공적으로 통합한 최초의 사례를 나타냅니다. Duke University 전기 및 컴퓨터 공학과의 수석 연구원 Haozhe "Harry" Wang은 이 시스템이 단순히 지시를 따르는 것이 아니라 이해할 수 있는 능력을 갖추고 있다고 설명했습니다.

"ATOMIC은 샘플을 평가하고, 스스로 결정을 내리며, 인간 전문가만큼 우수한 결과를 생성할 수 있습니다"라고 Wang은 설명했습니다. 이 시스템은 시판되는 광학 현미경을 이러한 AI 모델들에 연결하여, 샘플 이동, 이미지 초점 조정, 조명 조절을 자율적으로 제어하는 동시에 미세한 특징들을 분석할 수 있습니다.

중요한 연구 병목 현상 해결

이 개발은 재료 과학 연구의 주요 병목 현상을 해결하는데, 2차원 물질—원자 한 개 또는 몇 개 두께의 결정—을 특성화하는 작업은 전통적으로 수개월 또는 수년간의 전문 교육을 필요로 했습니다. 이러한 물질들은 차세대 반도체, 센서 및 양자 장치에 대한 가능성을 보여주지만, 제조 결함이 그들의 뛰어난 전기적 특성을 손상시킬 수 있습니다.

연구의 제1저자인 박사 과정 학생 Jingyun "Jolene" Yang은 "이 모델은 인간이 쉽게 볼 수 없는 규모에서 결정립계를 감지할 수 있었다"고 언급했습니다. 이 시스템은 과다 노출, 초점 불량 또는 낮은 조명을 포함한 최적이 아닌 이미징 조건에서도 높은 정확도를 유지했으며, 일부 경우에는 인간 관찰자에게 보이지 않는 결함을 식별했습니다.

광범위한 과학적 변혁

ATOMIC 시스템은 AI가 발견 과정의 모든 단계에 점점 더 참여하고 있는 과학 연구의 광범위한 변화를 반영합니다. KAIST, 드렉셀 대학교, 노스웨스턴 대학교 팀이 ACS Nano에 발표한 최근 연구는 AI가 이제 초기 발견부터 최적화까지 재료 연구 전반에 걸쳐 기능한다는 것을 보여줍니다. 한편, 다른 최근 개발 사례로는 Lila Sciences의 AI 기반 연구 공장과 같은 자율 실험실 플랫폼의 출시와 완전한 실험 워크플로우가 가능한 AI 시스템의 도입이 있습니다.

OpenAI의 Sam Altman이 최근 예측한 바와 같이, AI는 2년 내에 주요 과학적 발견을 할 수 있으며, 이는 연구에서 인공지능의 가속화되는 역할을 강조합니다. Wang의 팀은 AI가 인간의 전문성을 증폭시키지만, 결과를 해석하고 그 중요성을 결정하는 데는 연구자들이 여전히 필수적이라는 점을 강조하면서 이러한 광범위한 추세 속에 그들의 연구를 위치시켰습니다.