AI 가상 환자가 의료 교육에 도입되다

페이지 정보

본문

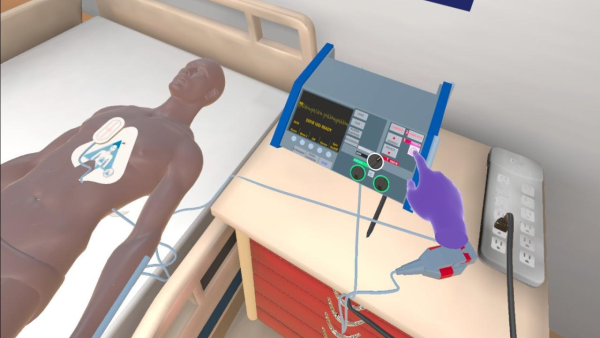

2025년 11월 12일 The Lancet Digital Health에 발표된 한 연구는 인공지능이 가상 환자와 메타버스 교실을 통해 어떻게 의학 교육을 재편할 수 있는지 자세히 설명하며, 2030년까지 세계보건기구가 예상하는 1,000만 명의 의료 인력 부족에 대한 잠재적 해결책을 제시합니다.

듀크-NUS 의과대학, 싱가포르 종합병원, 칭화대학교의 연구진들은 AI 기반 대규모 언어 모델이 현실적인 가상 환자 시뮬레이션을 생성하고 몰입형 디지털 환경에서 팀 기반 학습을 가능하게 하여, 의대생들이 물리적·재정적 제약 없이 임상 기술을 연습할 수 있도록 한다는 것을 입증했습니다.

듀크-NUS AI + 의학 과학 이니셔티브의 공동 제1저자이자 싱가포르 종합병원의 수석 임상 약사인 재스민 옹(Jasmine Ong) 박사는 “AI는 임상 교육자와 멘토를 대체하기 위한 것이 아니라 그들에게 힘을 실어주기 위한 것입니다”라고 말했습니다. 연구에 따르면, AI 도구는 학습 경험을 개인화할 수 있으며, 가상 환자는 전통적인 방법보다 더 일관되게 복잡한 임상 시나리오를 시뮬레이션할 수 있습니다.

정확성 및 편향성 우려

이 연구는 AI 정확성과 관련된 지속적인 문제들, 특히 AI가 잘못되거나 오해의 소지가 있는 정보를 생성하는 “환각(hallucination)” 현상을 확인했습니다. 연구들에 따르면 의료 맥락에서 환각 비율이 25%를 초과하며, AI 시스템이 자신감 있는 표현으로 사실상 부정확한 콘텐츠를 생성하는 것으로 나타났습니다.

“AI가 의학 교육과 훈련에 더욱 깊이 통합됨에 따라, 우리는 적절한 사용 보장, 학습 무결성 유지, 의도하지 않은 피해 방지와 같이 AI가 제기하는 윤리적 우려를 다뤄야 합니다”라고 Duke-NUS 정량 의학 센터의 선임 연구원이자 공동 제1저자인 Ning Yilin 박사가 말했습니다.

이 연구는 대규모 언어 모델이 성별과 인종과 관련된 편향을 보여왔으며, 의학 문헌으로 훈련된 AI 모델이 시간이 지남에 따라 체계적 불균형을 영속화할 위험이 있다고 강조합니다. MIT의 연구는 의료 영상으로부터 정확한 인구통계학적 예측을 하는 AI 모델이 서로 다른 인종이나 성별에 걸쳐 질환을 진단할 때 가장 큰 공정성 격차를 보인다는 것을 보여주었습니다.

협력적 프레임워크에 대한 요청

연구자들은 지속 가능한 AI 도입을 위해서는 의과대학, 의료기관, 산업 파트너, 그리고 정부 규제 기관 간의 협력이 필요하며, 이를 통해 책임감 있고 증거 기반의 솔루션을 개발해야 한다고 강조합니다.

Duke-NUS의 정량의학센터 부교수이자 Duke-NUS AI + 의과학 이니셔티브 디렉터인 Liu Nan 부교수는 “포괄적이고 글로벌한 전략을 향해 노력하고 여러 분야에 걸쳐 협력함으로써, 우리는 생성형 AI를 책임감 있게 배치하여 더욱 상호작용적이고 접근 가능한 교육을 만들고, 이러한 성과를 환자를 위한 더 나은 치료로 전환할 수 있습니다”라고 말했습니다.