엔지니어들이 자석을 사용하여 뇌와 유사한 컴퓨터 개발

페이지 정보

본문

(퍼플렉시티가 정리한 기사)

텍사스 대학교 댈러스 캠퍼스의 엔지니어들이 인간 두뇌 학습을 모방하는 뉴로모픽 컴퓨터 프로토타입을 개발했으며, 자기 부품을 사용하여 기존 인공지능 시스템에 비해 에너지 효율성을 극적으로 개선했습니다. 8월 Nature Communications Engineering에 발표된 이 획기적인 성과는 AI 처리를 스마트폰 및 기타 모바일 기기에 직접 적용하는 데 있어 중요한 진전을 의미합니다.

혁명적인 자기 뇌 기술

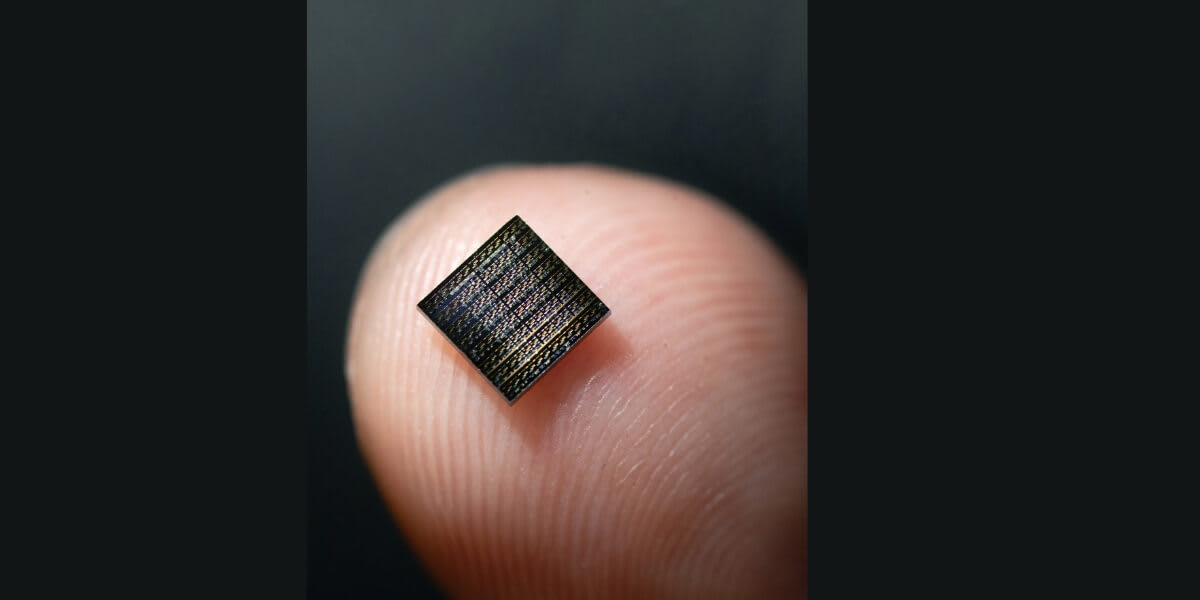

UT Dallas의 Joseph S. Friedman 박사와 그의 팀은 자기 터널 접합(MTJ)을 사용하여 프로토타입을 개발했습니다. MTJ는 활동 패턴에 따라 연결을 강화하거나 약화시켜 생물학적 시냅스처럼 작동하는 나노스케일 장치입니다. 메모리와 처리를 분리하는 기존 컴퓨터와 달리, 이 뉴로모픽 시스템은 인간의 뇌가 작동하는 방식을 모방하여 두 기능을 통합합니다.

전기 및 컴퓨터 공학 부교수인 Friedman은 "우리의 연구는 스스로 학습할 수 있는 뇌 기반 컴퓨터를 구축하기 위한 잠재적인 새로운 경로를 보여줍니다"라고 말했습니다. "뉴로모픽 컴퓨터는 대규모 학습 연산이 필요하지 않기 때문에 막대한 에너지 비용 없이 스마트 기기에 전력을 공급할 수 있습니다."

프로토타입은 테스트에서 놀라운 효율성을 보여주었으며, 와트당 초당 600조 회 이상의 연산을 달성했습니다. 이는 기존 멤리스터 시스템보다 6배 이상 효율적이며 표준 그래픽 프로세서보다 수천 배 더 효율적입니다. MNIST 데이터셋을 사용한 손글씨 숫자 인식 테스트에서 이 시스템은 기존 AI 하드웨어보다 훨씬 적은 전력을 소비하면서 90%의 정확도를 달성했습니다.

산업 협력 및 연방 지원

이 연구는 산업 파트너인 에버스핀 테크놀로지스(Everspin Technologies)와 텍사스 인스트루먼트(Texas Instruments)와의 협업을 통해 탄생했으며, 이 기술을 잠재적인 상업적 활용을 위해 포지셔닝하고 있습니다. 에버스핀 테크놀로지스의 사장이자 CEO인 산지브 아가왈(Sanjeev Aggarwal) 박사는 프리드먼(Friedman)과 함께 이 연구를 공동 집필했습니다.

2025년 9월, 미국 에너지부가 프리드먼에게 신경형 컴퓨팅 연구를 진전시키기 위해 2년간 498,730달러의 보조금을 수여하면서 프로젝트는 추가적인 동력을 얻게 되었습니다. 이러한 연방 자금 지원은 AI 시스템이 점점 더 막대한 전력을 소비함에 따라 에너지 효율적인 컴퓨팅 대안에 대한 정부의 관심이 커지고 있음을 보여줍니다.

이 연구는 종종 "함께 발화하는 뉴런은 함께 연결된다"로 요약되는 헤브 학습 원리에 기반하여, 인공 시스템이 방대한 사전 학습 없이도 경험을 통해 스스로 적응하고 학습할 수 있도록 합니다. MTJ 소자의 이진 스위칭 기능은 안정성 문제로 어려움을 겪었던 이전의 신경형 방식들과 비교해 신뢰성을 크게 향상시킵니다.

최근 분석에 따르면, 대규모 언어 모델 학습에는 300가구가 1년 동안 소비하는 전력만큼의 전기가 소모될 수 있는 반면, 인간의 두뇌는 20와트 전구 정도의 전력으로 복잡한 정보를 처리합니다. 신경형 칩은 기존 AI 시스템 대비 최대 80%까지 에너지 소비를 줄일 수 있어, 전력 효율성이 중요한 에지 컴퓨팅 분야에서 특히 높은 가치를 가질 수 있습니다.