Causely, 코드 에디터에서 Kubernetes 문제를 해결하는 AI 도구 출시

페이지 정보

본문

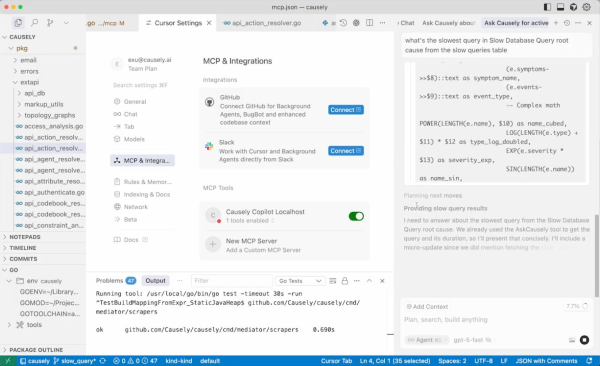

Causely는 수요일에 개발자의 코드 편집기에 직접 통합되는 Model Context Protocol 서버의 출시를 발표했으며, 이를 통해 개발자들은 자연어 명령을 사용하여 복잡한 Kubernetes 문제를 진단하고 해결할 수 있습니다.

다음 주 애틀랜타에서 열리는 KubeCon 컨퍼런스를 앞두고 공개된 새로운 MCP Server는 Cursor 및 Claude와 같은 인기 도구를 포함한 모든 MCP 호환 통합 개발 환경과 연결되어 Kubernetes 및 애플리케이션 코드에 대한 자동화된 문제 해결을 제공합니다. 이 플랫폼은 실시간으로 시스템 상태를 분석하여 문제가 인프라 계층에서 발생했는지 애플리케이션 계층에서 발생했는지 식별한 다음, 개발자의 작업 공간 내에서 직접 특정 코드 변경, 구성 업데이트 또는 Helm 차트 수정을 권장합니다.

Causely의 제품 책임자인 Ben Yemini는 “Causely의 MCP Server는 정교한 인과 추론을 개발자의 손에 직접 제공함으로써 인시던트 대응을 가속화합니다”라고 말했습니다. “Cursor 또는 Claude와 같은 IDE에 통합되면 MCP Server를 통해 엔지니어는 간단한 자연어 명령을 사용하여 문제나 원하는 결과를 설명할 수 있습니다.”

쿠버네티스 복잡성 해결

이 플랫폼은 클라우드 네이티브 환경에서 지속적으로 나타나는 과제를 해결합니다: 증상 식별과 근본 원인 이해 사이의 격차입니다. Kubernetes는 확장성과 유연성을 제공하지만, 그 복잡성으로 인해 엔지니어들은 근본적인 문제를 해결하지 않고 표면적인 문제만 임시방편으로 처리하는 경우가 많습니다. 기존 모니터링 도구는 데이터를 제공하지만, 문제 해결은 여전히 수동적이고 시간이 많이 소요됩니다.

Causely의 접근 방식은 서비스 종속성과 시스템 토폴로지를 자동으로 매핑하는 인과 AI 모델을 사용하여, 맞춤형 계측 없이도 플랫폼이 근본 원인을 정확히 찾아낼 수 있도록 합니다. 이 시스템은 Terraform, Helm 차트 또는 애플리케이션 코드에 대한 업스트림 패치를 생성하여 향후 배포에서 반복되는 문제를 방지합니다.

Amazon [ +0.56%]의 전 인공 일반 지능 부사장인 Karthik Ramakrishnan은 이 기술의 잠재력을 지지했습니다. “언어 모델은 강력하지만, 구조화된 인과 관계 맥락 없이는 올바른 결정을 내릴 수 없습니다”라고 그는 성명에서 밝혔습니다. “그것이 Causely가 메우는 격차이며, 실시간 자동화를 가능하게 만드는 요소입니다.”

광범위한 산업 동향

Causely의 발표는 여러 공급업체가 인프라 관리 도구에 MCP 지원을 통합하면서 나왔습니다. Buoyant는 11월 5일 Linkerd 서비스 메시에 MCP 기능을 추가하여 Kubernetes 환경의 에이전트 AI 트래픽에 보안 및 관찰성 기능을 확장할 것이라고 발표했습니다. 이 회사는 11월 10일부터 13일까지 애틀랜타에서 열리는 KubeCon에서 이 기술을 시연할 예정입니다.

2024년 11월 Anthropic에 의해 개방형 표준으로 도입된 MCP는 OpenAI와 Google DeepMind를 포함한 주요 AI 제공업체들로부터 채택되었습니다. 이 프로토콜은 AI 시스템이 외부 데이터 소스 및 도구와 연결할 수 있는 표준화된 인터페이스를 제공하며, Anthropic이 각 데이터 소스에 대해 맞춤형 커넥터가 필요했던 “N×M” 통합 문제라고 설명한 것을 해결합니다.

2022년에 설립된 Causely는 645 Ventures가 주도하고 Amity Ventures, Glasswing Ventures, Tau Ventures가 참여한 가운데 1,100만 달러 이상의 자금을 조달했습니다. 2024년 8월 CEO로 합류한 Yotam Yemini는 이전에 Quantum Metric과 IBM Turbonomic에서 시장 진출 업무를 이끌었습니다.

Gabriele님의 댓글