머스크의 그로키피디아, 극우 출처 인용한 것으로 연구 결과 밝혀져

페이지 정보

본문

(퍼플렉시티가 정리한 기사)

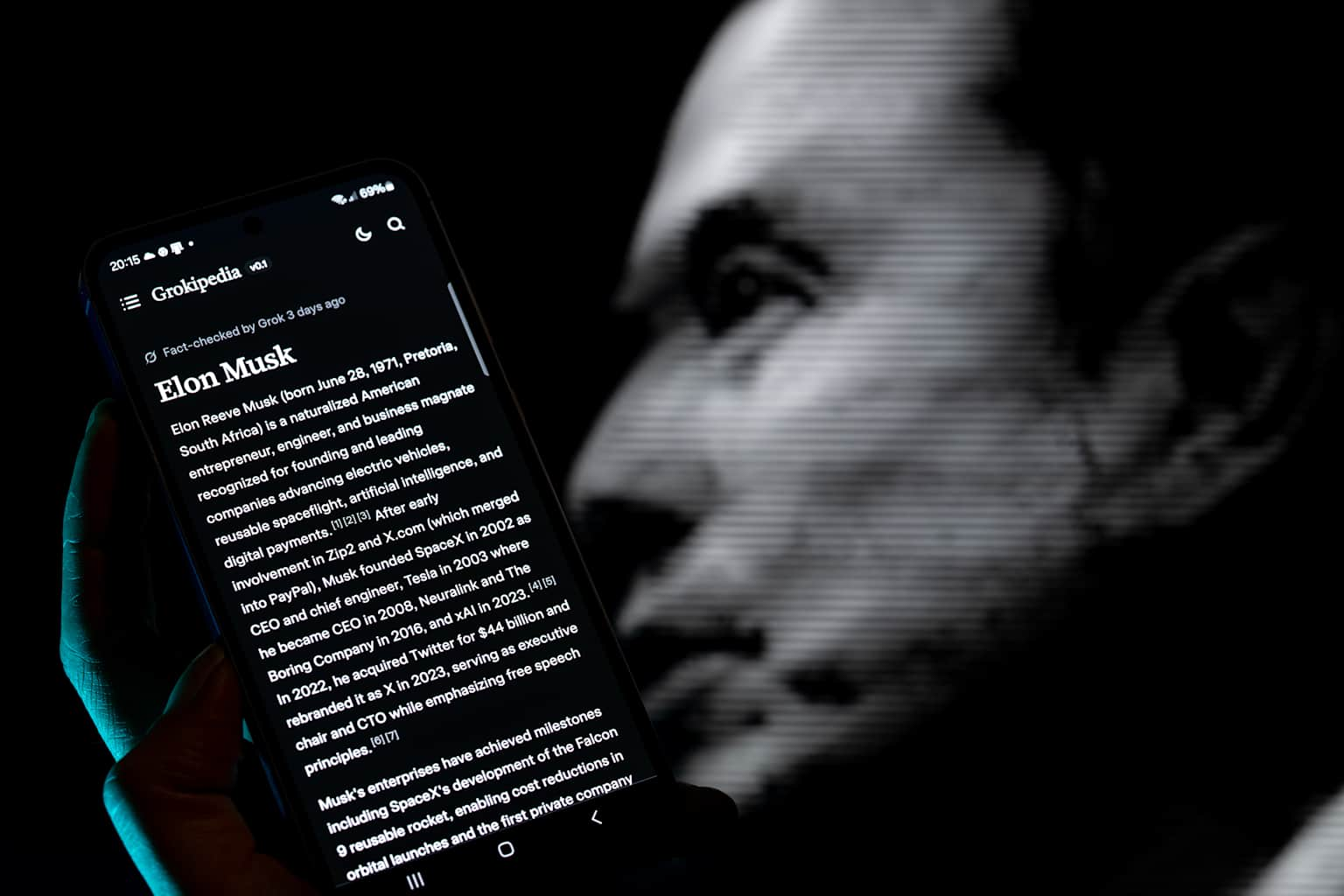

일론 머스크의 출시한 지 한 달 된 위키피디아 대체 서비스인 그로키피디아(Grokipedia)가 수천 개의 "의심스러운" 그리고 "문제가 있는" 출처를 인용하고 있어 AI 기반 백과사전의 신뢰성에 대한 심각한 의구심을 불러일으키고 있다고 코넬 테크 연구진이 금요일 발표한 연구 결과가 밝혔다.

연구에 따르면 위키피디아에서 복사되지 않은 그로키피디아 문서는 영어 위키피디아 커뮤니티에서 "일반적으로 신뢰할 수 없는" 것으로 간주되는 출처를 인용할 가능성이 3.2배 더 높고, 위키피디아가 완전히 차단하는 "블랙리스트" 출처를 포함할 가능성이 13배 더 높은 것으로 나타났다. 인용 중에는 스톰프론트(Stormfront)와 인포워즈(InfoWars)를 포함한 극우 매체에 대한 수십 건의 참조가 포함되어 있다.

코넬 테크 연구진인 해롤드 트리드먼(Harold Triedman)과 알렉시오스 만차를리스(Alexios Mantzarlis)는 보고서에서 "그로키피디아에서는 출처 관련 안전장치가 대부분 제거된 것이 분명하다"고 썼다. "이로 인해 의심스러운 출처가 포함되고, 잠재적으로 문제가 있는 출처의 전반적인 비율이 더 높아지게 된다."

논란 속에 출범한 위키백과 경쟁 서비스

머스크의 회사 xAI는 10월 27일 80만 개 이상의 AI 생성 기사를 담은 그로키피디아를 출시하며, 머스크가 "위키피디아보다 엄청난 개선"이라고 부른 것으로 포지셔닝했다. 이 억만장자는 오랫동안 위키피디아를 좌파 편향이라고 비난해왔으며, 이를 "Wokepedia"라고 부르고 작년에 2억 명 이상의 X 팔로워들에게 비영리 단체에 기부를 중단할 것을 촉구했다.

그러나 이 플랫폼은 정확성 문제로 빠르게 비판을 받았다. PolitiFact는 그로키피디아가 존재하지 않는 출처를 인용하거나 참조된 정보를 포함하지 않는 출처를 인용하는 등 허위 인용을 자주 만들어낸다는 것을 발견했다. 한 사례에서, 백과사전은 파이스트의 아버지가 2021년에 사망했다는 Vice 기사를 인용했는데, 실제 기사는 2017년 것이었고 사망에 대한 언급이 없었으며 당시 그녀의 아버지는 여전히 살아있었다.

위키피디아 공동 창립자 지미 웨일스는 이 프로젝트를 일축하며 CNBC에 대규모 언어 모델이 "대규모 오류"를 만들어낼 것이라고 말했다. "저는 그로키피디아를 철저히 검토할 기회가 없었고, 흥미롭게 생각하지만, 일론 머스크의 탁월함에 대한 찬사로 가득 차 있는 것 같습니다"라고 웨일스는 말했다.

투명성 격차와 이념적 우려

공개 편집을 허용하고 변경 사항과 출처에 대한 상세한 기록을 유지하는 위키백과와 달리, 그로키피디아는 기사가 AI로 생성되었다는 점을 인정하는 것 외에는 기사 작성 방법에 대한 어떠한 통찰도 제공하지 않습니다. 사용자는 양식을 통해 피드백을 제출할 수는 있지만 항목을 직접 편집할 수는 없습니다.

이 플랫폼은 논란의 여지가 있는 주제를 다루는 방식으로 특히 면밀한 조사를 받았습니다. 한 분석에 따르면, 그로키피디아의 1월 6일 국회의사당 공격에 대한 항목은 사건 자체보다 언론 보도에 대한 이의 제기에 더 초점을 맞추고 있습니다. 이 백과사전에는 또한 InfoWars를 인용하는 "클린턴 시체 수" 음모론을 홍보하는 기사도 포함되어 있습니다.

코넬 공대 연구 결과에 대한 논평 요청을 받았을 때, xAI는 "레거시 미디어는 거짓말을 한다(Legacy Media Lies)"라는 자동 응답을 보냈습니다. 목요일, 머스크는 그로키피디아가 "충분히 좋아지면(아직 갈 길이 멀지만)" "은하 백과사전(Encyclopedia Galactica)"으로 브랜드를 변경할 계획이라고 발표했습니다.