틱톡, 사용자가 피드의 AI 콘텐츠를 제어할 수 있도록 허용

페이지 정보

본문

(퍼플렉시티가 정리한 기사)

TikTok은 11월 18일 사용자들이 피드에 표시되는 AI 생성 콘텐츠의 양을 조절할 수 있도록 허용할 것이라고 발표했으며, 이는 인공적으로 생성된 콘텐츠의 유입에 대한 사용자 불만에 대응하는 소셜 플랫폼의 증가 추세에 동참하는 것이다. 이 동영상 공유 앱은 또한 기존 탐지 방법을 우회하는 AI 콘텐츠를 더 잘 식별하기 위해 고급 "비가시 워터마킹" 기술을 테스트하고 있다.

새로운 제어 및 탐지 기술

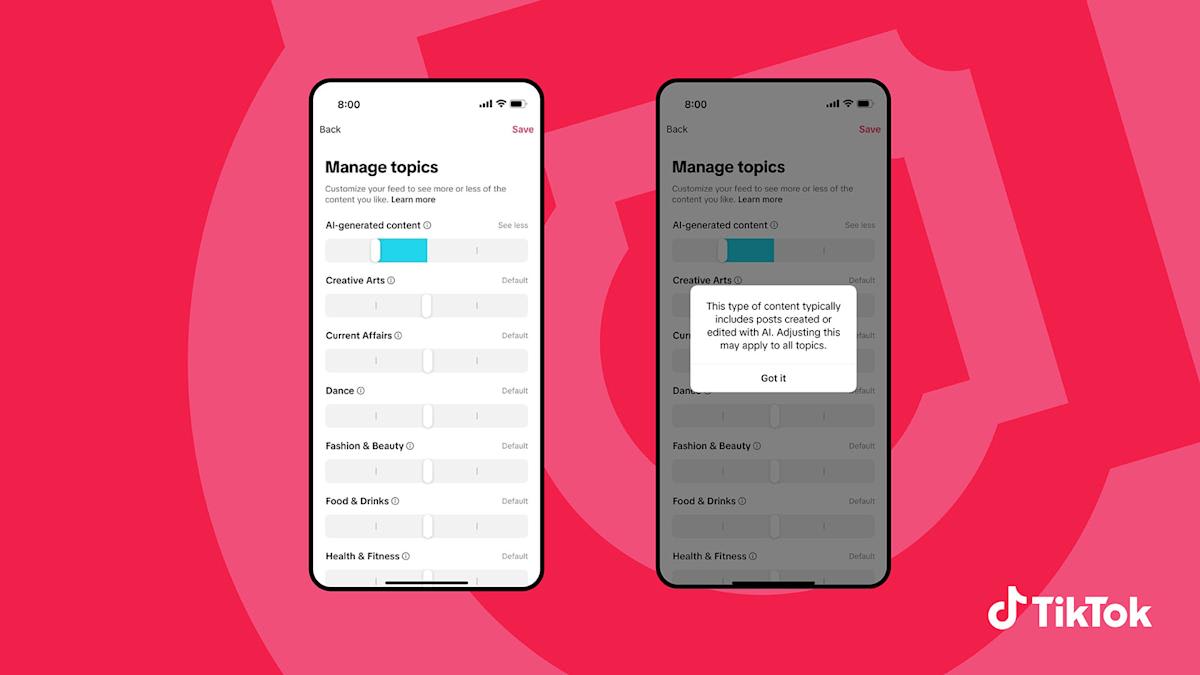

앞으로 몇 주 안에 출시될 이 기능은 TikTok의 기존 "주제 관리" 도구 내의 콘텐츠 환경설정(Content Preferences)에서 확인할 수 있습니다. 사용자는 슬라이더를 이동하여 스포츠나 음식 등 카테고리 피드를 사용자 정의하듯 AI 생성 콘텐츠를 더 많이 또는 더 적게 볼 수 있습니다. 플랫폼 측은 이 컨트롤이 "피드 내의 콘텐츠를 완전히 제거하거나 교체하는 것이 아니라, 피드 내의 다양한 콘텐츠 범위를 사용자가 조정할 수 있도록 설계된 것"이라고 밝혔습니다.

TikTok은 이제 AI 생성으로 라벨링된 동영상이 13억 개 이상에 달한다고 공개했습니다. 이미 회사는 AI 콘텐츠를 태그하기 위해 C2PA Content Credentials(산업 전반의 메타데이터 시스템)을 사용하고 있지만, 이러한 라벨은 다른 플랫폼에서 동영상이 다시 편집되거나 업로드될 때 제거될 수 있습니다. 이번에 도입되는 새로운 보이지 않는 워터마크는 TikTok만 읽을 수 있으며, 플랫폼의 AI Editor Pro 도구로 생성된 콘텐츠와 Content Credentials를 포함하는 업로드에 추가됩니다.

이런 조치는 핀터레스트(Pinterest)가 'AI 슬롭'이 피드를 도배한다는 비판을 받은 뒤, 10월에 특정 카테고리에서 AI 생성 이미지를 제한할 수 있는 컨트롤을 도입한 것과 유사합니다. 두 이니셔티브 모두 Meta Platforms, Inc.(메타)와 OpenAI가 AI로만 생성된 영상 콘텐츠만 제공하는 전용 플랫폼(Vibes와 Sora)을 론칭하며 반대 방향으로 나아가는 시점에 등장했습니다.

AI 확산에 대한 산업계의 대응

TikTok은 "AI가 개인이 창의성을 표현하는 방식을 혁신할 수 있다고 믿는다"고 강조하면서도 투명성의 중요성을 강조했다. 이 회사는 책임 있는 AI 관행에 초점을 맞춘 비영리 단체인 Partnership on AI, 그리고 Girls Who Code와 같은 단체들과 파트너십을 맺어 교육 콘텐츠를 제작하기 위한 200만 달러 규모의 AI 리터러시 기금을 발표했다.

11월 18일 더블린에서 열린 TikTok 신뢰 및 안전 포럼에서 전문가들은 폭력적 극단주의자들이 플랫폼 가이드라인 위반을 피하는 메시지를 생성하여 콘텐츠 조정을 회피하기 위해 생성형 AI를 사용하고 있다고 경고했다. 이 회사는 AI 라벨링 발표와 함께 독일에서 극단주의 관련 용어를 검색하는 사용자를 위한 새로운 교육 프롬프트를 도입했다.