AMD, 엔비디아에 도전하기 위해 Helios AI 플랫폼 공개

페이지 정보

본문

(퍼플렉시티가 정리한 기사)

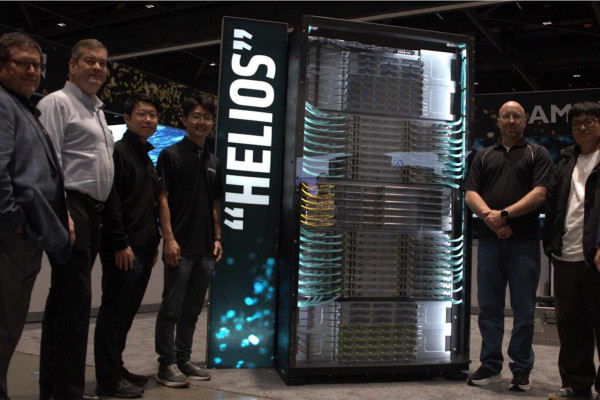

AMD는 월요일 산호세에서 열린 Open Compute Project Global Summit에서 Helios 랙 규모 AI 플랫폼을 공개하며, AI 인프라 시장에서 Nvidia의 지배력에 대한 과감한 도전을 알렸습니다. 이 발표는 Oracle이 2026년 3분기부터 50,000개의 AMD Instinct MI450 GPU를 배포하기로 약속하며 첫 주요 고객이 된 것과 동시에 이루어졌습니다.

Helios 플랫폼은 급속도로 확장되는 AI 데이터 센터 시장에서 경쟁하기 위한 AMD의 가장 야심찬 노력을 나타내며, Meta의 새로운 Open Rack Wide 사양을 활용하여 Nvidia의 차기 Vera Rubin 아키텍처보다 50% 더 많은 메모리 용량을 제공한다고 회사는 주장합니다. 각 Helios 랙은 72개의 MI450 GPU를 탑재하고 있으며, 31TB의 HBM4 메모리와 1.4 PB/s의 총 대역폭으로 최대 1.4 엑사플롭스의 FP8 성능을 제공합니다.

오라클 파트너십은 주요 검증을 의미합니다

업계 분석가들에 따르면 약 35억~40억 달러 규모로 평가되는 오라클과의 계약은 AMD의 AI 전략에 대한 중요한 검증을 의미합니다. 오라클 클라우드 인프라스트럭처는 MI450 프로세서로 구동되는 최초의 공개 이용 가능한 AI 슈퍼클러스터의 일환으로 50,000개의 GPU를 배치할 예정이며, 2027년 이후 확장 계획을 가지고 있습니다.

"고객들은 극한의 확장성과 효율성을 위해 설계된 적응 가능하고 개방적인 컴퓨팅 솔루션을 필요로 합니다"라고 오라클은 파트너십 발표에서 밝혔습니다. 이번 배치는 MI450 GPU와 차세대 EPYC "Venice" CPU, 그리고 Pensando "Vulcano" 네트워킹 기술을 결합한 AMD의 통합 Helios 랙 디자인을 활용할 것입니다.

AMD의 주가는 이번 발표 이후 시간외 거래에서 3% 이상 상승했으며, 이는 주로 회사의 최근 AI 파트너십에 힘입어 올해 85% 상승한 것에 더해진 것입니다. 오라클과의 계약은 AMD가 수년간 6기가와트의 GPU 용량을 제공하기로 OpenAI와 수십억 달러 규모의 계약을 체결한 지 불과 일주일 만에 이루어졌습니다.

Nvidia 생태계에 대한 개방형 표준 도전

Helios 플랫폼은 Nvidia의 독점 생태계에 대한 대안으로 개방형 표준을 촉진하는 AMD의 전략을 구현합니다. 기가와트 규모의 데이터 센터에 최적화된 더블 와이드 랙을 정의하는 Meta의 Open Rack Wide 사양을 기반으로 구축된 Helios는 UALink 및 Ultra Ethernet Consortium 아키텍처를 포함한 개방형 컴퓨팅 표준을 통합합니다.

AMD 데이터 센터 솔루션 부문 수석 부사장인 Forrest Norrod는 "개방형 협업은 AI를 효율적으로 확장하는 핵심입니다"라고 말했습니다. "Helios를 통해 우리는 개방형 표준을 실제 배포 가능한 시스템으로 전환하고 있습니다".

각 MI450 GPU는 최대 432GB의 HBM4 메모리와 19.6 TB/s의 메모리 대역폭을 제공하여 AMD에게 메모리 집약적인 AI 워크로드에서 잠재적인 이점을 제공합니다. 이 플랫폼은 또한 AMD가 이전 세대 대비 17.9배 높은 성능을 제공하며 Nvidia의 경쟁 시스템인 Vera Rubin과 비교하여 우수한 메모리 사양을 제공한다고 설명합니다.